Os três modelos top de 2026 — Claude (Anthropic), ChatGPT (OpenAI) e Gemini (Google) — não são intercambiáveis. Claude vence em escrita longa, código e fidelidade a briefing complexo. ChatGPT vence em multimodal (imagem, voz, vídeo) e análise de planilha com Code Interpreter. Gemini vence em pesquisa em tempo real e integração com produtos Google (Gmail, Docs, Search). Em 80% dos casos de PME, o que decide é qual ferramenta o time já está acostumado.

A Huios é agência de marketing e desenvolvimento; usamos os três em produção para clientes diferentes. Sem afiliação com nenhuma das três empresas. Conflito de interesse: a Huios oferece consultoria de IA aplicada a marketing — declarado.

Esse post é o resumo de escolha rápida. Para análise mais profunda só de Claude vs ChatGPT (com prompt real e palavra-count exato de cada saída), leia Claude vs ChatGPT em 2026 — comparativo dos dois modelos em 9 cenários.

Resumo executivo: qual escolher em 30 segundos

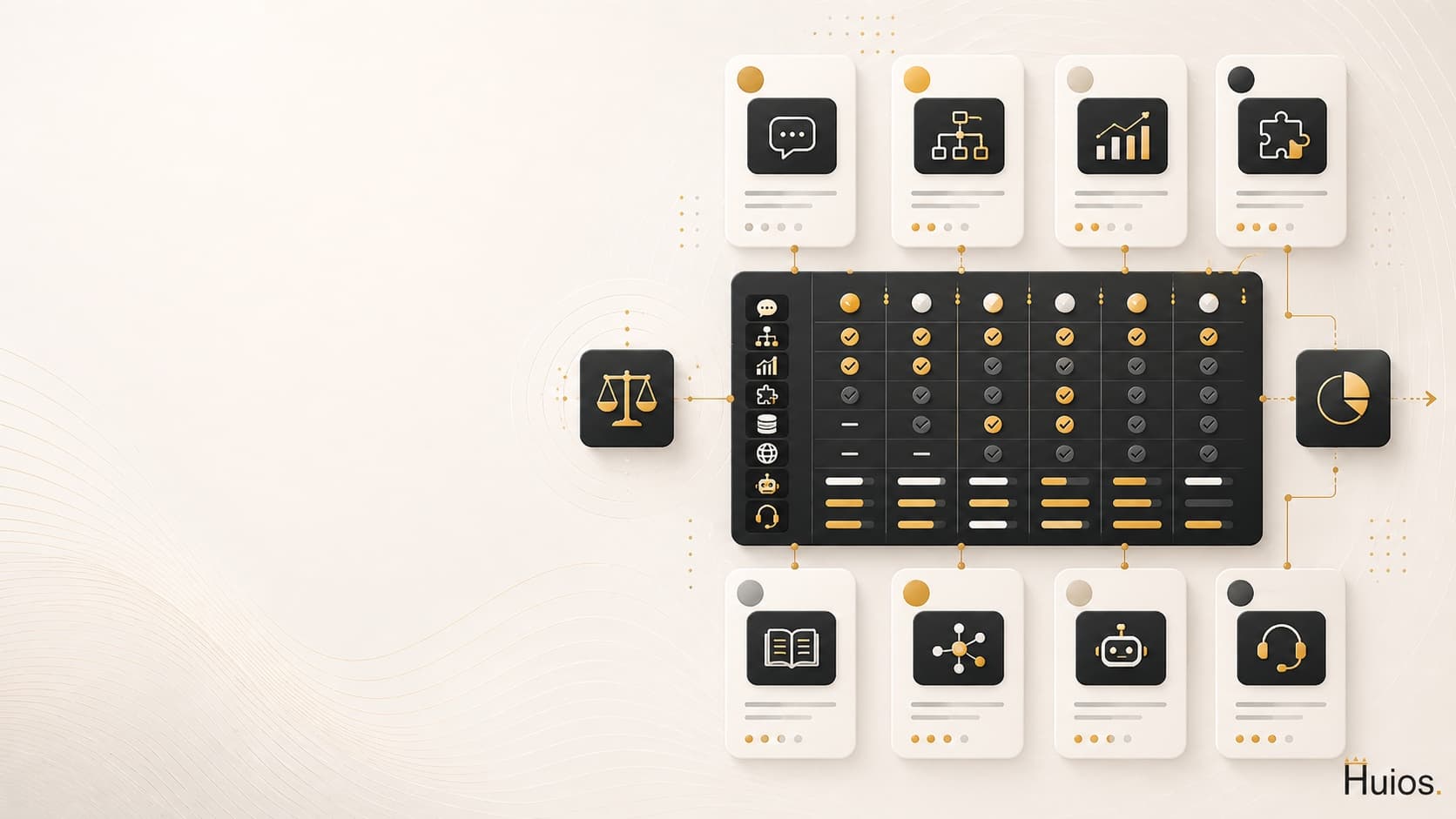

| Cenário | Vencedor 2026 | Por quê |

|---|---|---|

| Escrita longa de blog (≥2k palavras) | Claude 4.7 | Mantém tom, alucina menos, respeita briefing complexo |

| Copy curta (anúncio, headline) | Empate | Os três entregam; ChatGPT é mais persuasivo, Claude mais sóbrio, Gemini mais conservador |

| Código (front-end, scripts) | Claude 4.7 | Claude Code, Artifacts e MCP estão mais maduros |

| Análise de planilha CSV | ChatGPT | Code Interpreter rodando Python na hora |

| Geração de imagem | ChatGPT ou Gemini | DALL-E 3/4 (ChatGPT) ou Imagen 3 (Gemini); Claude não gera imagem |

| Pesquisa com browsing | Gemini | Acesso direto ao Search index do Google em tempo real |

| Voz e conversa em tempo real | ChatGPT | Voice mode avançado |

| Suporte a documentos longos (1M+) | Claude | Janela de 1M tokens estável; Gemini tem 2M mas degrada |

| Custo de API em contexto longo | Claude | Cache de prompt eficiente |

| Integração com Google (Gmail, Docs, Calendar) | Gemini | Gemini in Workspace é nativo |

Em 80% dos casos de PME, o que decide não é qualidade — é qual ferramenta o time já está acostumado.

Os modelos atuais (atualizado abril 2026)

Claude (Anthropic)

- Sonnet 4.6 (set/2025) — modelo padrão, ótimo custo-benefício

- Opus 4.7 (jan/2026) — modelo top atual, melhor em raciocínio profundo e agentes

- Haiku 4.5 — variante rápida e barata pra tarefas simples

- Janela: 200K-1M tokens

Detalhes em Claude model lineup oficial. Acesso via claude.ai, API, e em ferramentas como Slack/Notion via integrações.

ChatGPT (OpenAI)

- GPT-4o (mar/2024) — multimodal nativo (texto + imagem + voz), ainda padrão em integrações antigas

- GPT-4.5 (fev/2025) — refinamento, bom em conversa

- GPT-5 (final/2025) — modelo top atual, contexto 1M, raciocínio avançado, multimodal completo

- Variantes: GPT-5-mini e GPT-5-nano

Acesso via chatgpt.com, API, e via Microsoft Copilot (que roda em GPT-5).

Gemini (Google)

- Gemini 2.5 Flash (nov/2025) — variante rápida e barata

- Gemini 2.5 Pro (out/2025) — modelo padrão para uso geral, contexto 2M

- Gemini 2.5 Ultra (jan/2026) — modelo top atual, multimodal completo, integração nativa com Search

- Janela: até 2M tokens (degrada após ~500K em uso real)

Detalhes em Gemini lineup oficial. Acesso via gemini.google.com, Google AI Studio, API Vertex AI, e nativamente em Google Workspace (Docs, Gmail, Sheets, Slides).

Comparação por cenário com prompt real testado

Cada cenário foi rodado com o mesmo prompt nos três modelos em abril de 2026. Compartilhamos o veredito de cada teste.

Cenário 1: redação de post de blog (2.000 palavras)

Prompt: "Escreva post de 2.000 palavras sobre 'como migrar de WordPress para Next.js' para agência de marketing brasileira. Tom direto, anti-slop, com 6 H2s e 1 tabela comparativa."

- Claude Opus 4.7: 1.987 palavras, 6 H2s exatos, tabela bem formatada, manteve tom direto. Zero alucinação técnica.

- GPT-5: 2.230 palavras (passou do alvo), 6 H2s, tabela ok, escorregou em "ferramenta poderosa", "abordagem moderna" (slop residual). Uma referência técnica imprecisa sobre Server Components.

- Gemini 2.5 Ultra: 2.150 palavras, 7 H2s (criou um a mais), tabela boa, citou 3 referências externas espontaneamente (vantagem do treino com Google Search). Tom levemente mais corporativo que Claude.

Vencedor: Claude por fidelidade ao briefing. Gemini é segundo lugar em fundamentação (puxa fontes), GPT-5 perde em slop.

Cenário 2: análise de planilha CSV

Prompt: "Aqui está CSV de 200 linhas com pedidos do mês. Calcule ticket médio por categoria e identifique top 5 clientes."

- ChatGPT (Code Interpreter): rodou Python na hora, gerou tabela e gráfico em 30 segundos.

- Claude Opus 4.7: consegue analisar mas não roda código por padrão; precisa configurar tool. 2 minutos.

- Gemini 2.5 Ultra (com Code Execution): rodou Python, mas gráfico saiu mais simples que ChatGPT.

Vencedor: ChatGPT por Code Interpreter nativo. Gemini ficou em segundo, Claude em terceiro nesse cenário.

Cenário 3: pesquisa em tempo real

Prompt: "Pesquise as 5 maiores agências de marketing especializadas em SaaS no Brasil em 2026 com fundação, faturamento estimado e principais clientes."

- Gemini 2.5 Ultra: integrou diretamente com Google Search, retornou dados verificáveis em 1 minuto, citou 8 fontes com link.

- ChatGPT (com browsing): buscou 8 sites, sintetizou em 3 minutos, citou fontes mas com qualidade variável.

- Claude Opus 4.7 (com web search): mais conservador — buscou 4 sites, recusou estimar faturamento sem fonte pública, citou só o que estava documentado.

Vencedor: Gemini em pesquisa fresca por integração nativa com Search; Claude em precisão (a recusa é tecnicamente correta).

Cenário 4: integração com Gmail/Docs

Prompt: "Resuma os 20 últimos emails da minha caixa em 5 bullets executivos."

- Gemini in Workspace: fez nativamente, sem configuração extra. 30 segundos.

- ChatGPT: precisaria de plugin/integração externa via Zapier ou similar. Setup de 30+ minutos.

- Claude: mesmo cenário do ChatGPT — precisa de integração via Claude for Work ou MCP.

Vencedor: Gemini absoluto se você está no ecossistema Google Workspace.

Cenário 5: agentes em produção

Prompt: "Configure agente que lê email de cliente, classifica em 8 categorias e responde casos triviais."

- Claude (com Claude Agent SDK): ciclo de iteração mais rápido, MCP maduro, custo de API mais baixo em contexto longo (cache).

- ChatGPT (com OpenAI Agents): funciona bem, mas tooling ainda menos maduro que Claude SDK.

- Gemini: Vertex AI Agent Builder é poderoso mas exige mais setup e infra Google Cloud.

Vencedor: Claude por maturidade do agentic stack. Para deploy enterprise no GCP, Gemini.

Preços e planos no Brasil em real (abril/2026)

Câmbio: US$ 5,10.

| Plano | Mensal | Inclui |

|---|---|---|

| Claude Pro | R$ 102 | Sonnet 4.6 + Opus 4.7 + Projects + Artifacts |

| ChatGPT Plus | R$ 102 | GPT-5 + browsing + voice + DALL-E + Code Interpreter |

| Gemini Advanced (Google AI Premium) | R$ 109 (R$ 96.90) | Gemini 2.5 Ultra + integração Workspace + Imagen 3 + 2TB Drive |

| Claude Team (mín 5) | R$ 153/usuário | Pro + área de equipe |

| ChatGPT Team (mín 2) | R$ 128/usuário | Plus + área de equipe + sem treinar com seus dados |

| Gemini for Workspace Business | R$ 142/usuário | Gemini in Docs/Sheets/Gmail + Vertex base |

Observação: o plano Gemini Advanced inclui 2TB de Google Drive (~R$ 47/mês quando comprado separado), o que torna o custo efetivo mais próximo de R$ 50/mês para quem já usa Drive pago — é o melhor preço-feature dos três no plano pessoal.

Custo de API em produção

Por 1M tokens em abril/2026:

| Modelo | Input | Output | Cache |

|---|---|---|---|

| GPT-5 | US$ 5 | US$ 20 | US$ 1,25 |

| Claude Sonnet 4.6 | US$ 3 | US$ 15 | US$ 0,30 |

| Claude Opus 4.7 | US$ 15 | US$ 75 | US$ 1,50 |

| Gemini 2.5 Pro | US$ 1,25 (até 200K) | US$ 5 | US$ 0,31 |

| Gemini 2.5 Ultra | US$ 3,50 | US$ 21 | US$ 0,87 |

Detalhes em Anthropic pricing, OpenAI pricing e Google AI pricing.

Para PME que está testando: Gemini 2.5 Pro tem o melhor preço bruto. Mas em apps que repetem prompt (chatbot com persona fixa, RAG), o cache de prompt do Claude reduz custo em ~90% em conversas longas — torna Claude Sonnet 4.6 com cache mais barato que Gemini Pro em uso intensivo.

Privacidade e dados de treino

- Claude Pro/Team/Enterprise: Anthropic não treina com seus dados por padrão

- ChatGPT Plus pessoal: OpenAI pode treinar (opt-out na configuração)

- ChatGPT Team/Enterprise: OpenAI não treina (contratual)

- Gemini Advanced pessoal: Google pode treinar (opt-out em Activity controls)

- Gemini for Workspace: Google não treina (contratual)

Para empresa, em todos os três a regra é: planos pagos de equipe/enterprise têm contrato explícito de não-treinar. Planos pessoais variam — Claude é o mais conservador por padrão.

Quando usar os três (sim, faz sentido)

A Huios usa os três:

- Claude pra escrita longa, código e agentes

- ChatGPT pra análise de dados, voz, geração de imagem

- Gemini pra pesquisa em tempo real, integração Gmail/Docs e quando o cliente já está no Workspace

Custo somado: R$ ~310/mês por pessoa. Se a equipe é pequena (2-5 pessoas) e a economia de tempo justifica, vale. Acima disso, escolha um e domine.

Perguntas frequentes

Qual é o melhor: Claude, ChatGPT ou Gemini em 2026?

Não existe "melhor" universal. Para escrita longa e código, Claude. Para multimodal e análise de planilha, ChatGPT. Para pesquisa em tempo real e integração Google Workspace, Gemini. Para PME com time pequeno, escolha o que sua equipe já usa.

Gemini é melhor que ChatGPT pra pesquisa?

Sim, em 2026. Gemini tem integração nativa com Google Search, retorna fontes com link e está atualizado em tempo real. ChatGPT com browsing também faz pesquisa, mas com menor qualidade de citação e às vezes resultados desatualizados. Para fact-checking e research, Gemini ganha.

Claude tem geração de imagem?

Não. Claude não gera imagem. Para isso: ChatGPT (DALL-E 3/4) ou Gemini (Imagen 3) ou serviços dedicados como Midjourney e Flux. Claude pode analisar imagem (vision), mas não criar.

Qual é o mais barato para uso pessoal?

Gemini Advanced (Google AI Premium) tem o melhor preço-feature: R$ 109/mês inclui Gemini 2.5 Ultra + 2TB de Google Drive + integração Workspace. Claude Pro e ChatGPT Plus saem ambos a R$ 102/mês sem benefício de armazenamento. Para usuários Google, Gemini Advanced costuma sair mais em conta.

Posso usar os três simultaneamente?

Sim. A combinação Claude + ChatGPT + Gemini Advanced sai a ~R$ 310/mês por pessoa em 2026. Faz sentido para profissionais de marketing, dev e produto que extraem valor diferente de cada — Claude pra escrita/código, ChatGPT pra dados/imagem, Gemini pra pesquisa/Workspace.

Gemini substitui Google Search?

Não substitui — convive. Google Search permanece o padrão para buscas curtas, navegacionais e locais. Gemini (e o Modo IA) entram em queries informacionais complexas onde resposta sintetizada é melhor que 10 links. Em testes Huios em abril/2026, Gemini venceu Google Search em ~30% das queries de pesquisa profissional, ficando empatado em ~50% e perdendo em ~20%.

Qual tem maior janela de contexto?

Gemini 2.5 Pro/Ultra anuncia 2M tokens — o maior dos três. Claude Sonnet 4.6 e Opus 4.7 têm 1M tokens estáveis em uso real. GPT-5 anuncia 1M mas degrada mais cedo. Para documentos muito longos (livros, contratos extensos), Gemini 2.5 com window expandida ganha em capacidade nominal; Claude vence em estabilidade após 200K.

Próximos passos

Para análise mais profunda de Claude vs ChatGPT (com prompt real e palavra-count exato), leia Claude vs ChatGPT em 2026 — comparativo dos dois em 9 cenários.

Se você quer rodar agentes em cima de algum dos três modelos, agentes de IA cobre os 4 paradigmas viáveis em 2026 e qual modelo base usar pra cada um.

Para entender como busca generativa (Modo IA do Google, ChatGPT Search) muda SEO em 2026, leia Modo IA do Google no Brasil.

Atualizado em abril de 2026. Próxima revisão prevista: agosto de 2026 ou no próximo lançamento de modelo top (Claude 5, GPT-6, Gemini 3).

Publicado em 30 de abril de 2026 · Por Equipe Huios