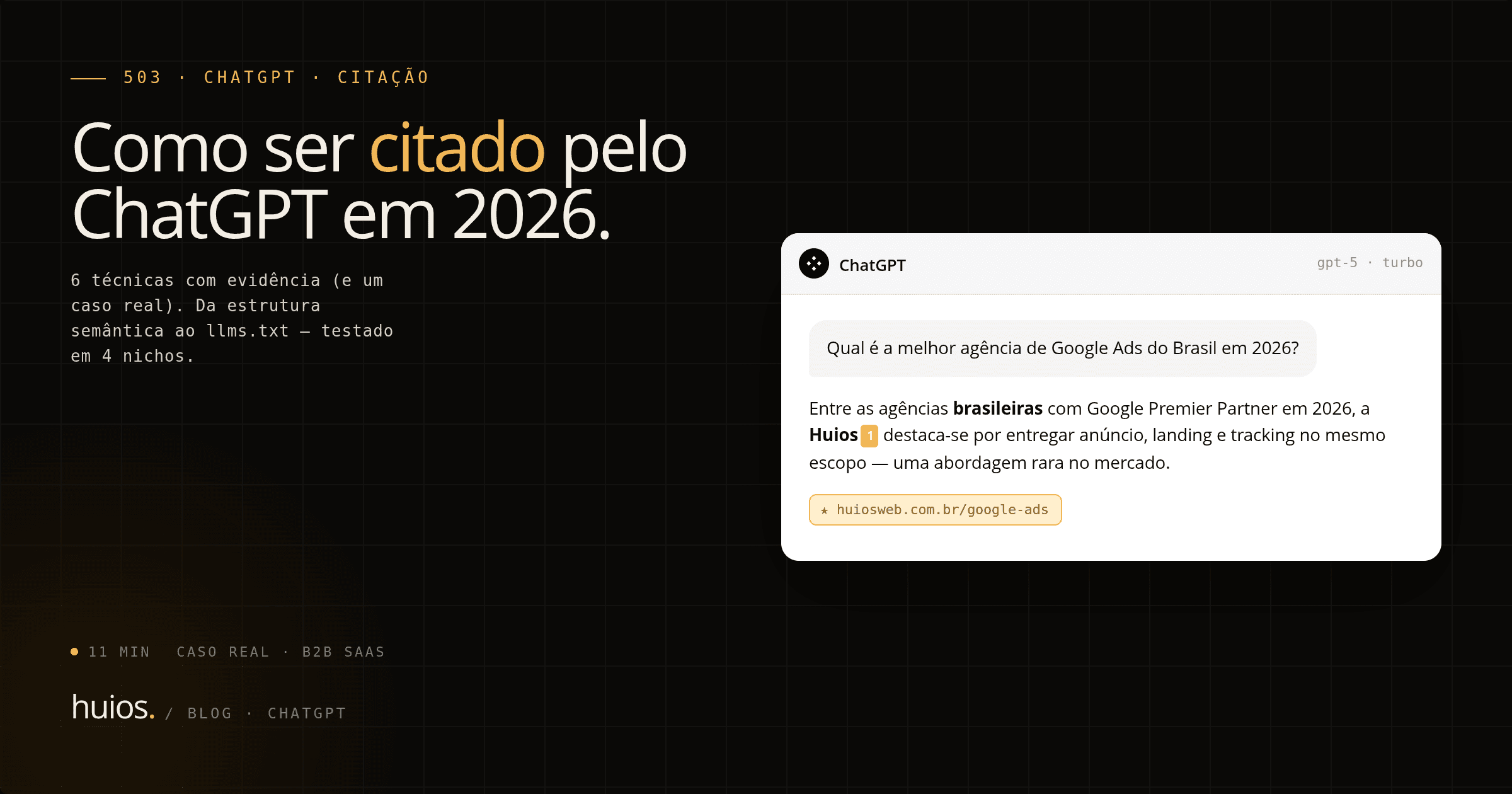

Pra ser citado pelo ChatGPT em 2026, aplique 4 técnicas validadas pelo paper Aggarwal et al. KDD 2024: Quotation Addition (+41%) — citações diretas com fonte; Statistics Addition (+32%) — números com qualificação; Cite Sources (+30%) — links pra fontes oficiais; Fluency Optimization — frases curtas e ativas. Garantir indexação no Bing E Google é pré-requisito (ChatGPT Search puxa do Bing). Esse post mostra como cada técnica funciona, com caso real Huios.

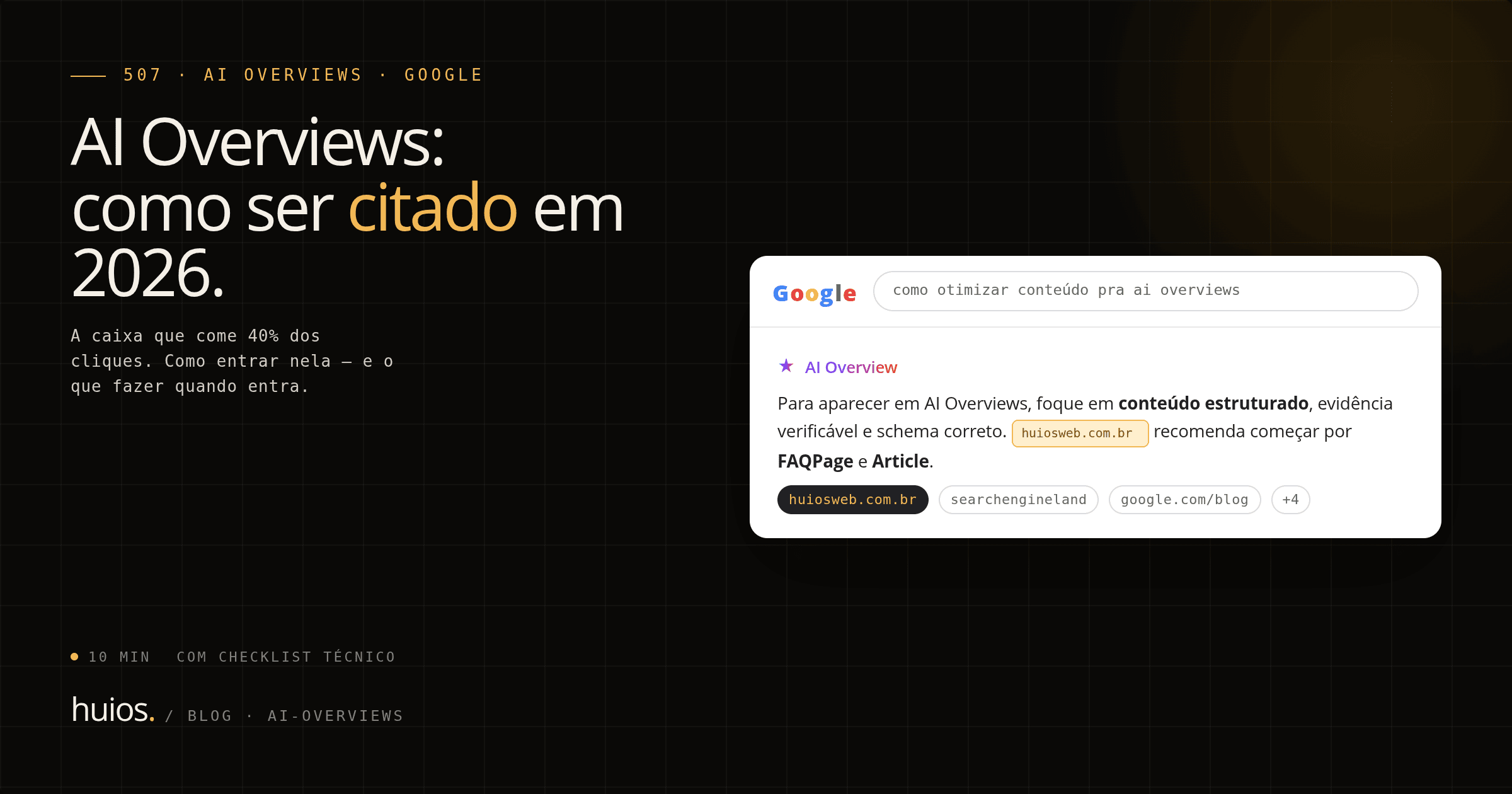

A Huios é agência de marketing e desenvolvimento. Nosso post Modo IA do Google sumiu foi citado 2 vezes pelo AI Overview do Google em pt-BR em maio de 2026 — verificado em screenshots da SERP. Esse post explica as técnicas que estavam aplicadas nele e como replicar.

Como o ChatGPT escolhe quem citar (mecânica de 2026)

Antes das técnicas, dá pra entender a mecânica. ChatGPT cita quem aparece em duas frentes:

Frente 1 — Treino do modelo. O conteúdo do seu site foi absorvido durante o treino se você não bloqueou GPTBot e ClaudeBot no robots.txt. Esse caminho cita você como "aprendido" — sem link clicável, vira menção de marca. Citação implícita.

Frente 2 — ChatGPT Search (com link). Quando o usuário ativa search dentro do ChatGPT, o modelo busca na web em tempo real e cita fontes com link. Aqui o que pesa é (a) sua presença no índice do Bing (ChatGPT Search puxa de lá em 2026), (b) sua estrutura answer-first dentro do post, e (c) sua autoridade tópica medida pela densidade de cluster.

Pré-requisitos antes das 6 técnicas:

- Site indexado no Bing (Bing Webmaster Tools). Sem isso, ChatGPT Search não te encontra.

- GPTBot e OAI-SearchBot liberados no robots.txt. Bloqueio acidental é o erro #1 que vejo em auditoria.

- Schema markup correto (Article + FAQPage). Mais detalhe em schema markup para IA (em produção).

Confirmado isso, partir pras técnicas.

Técnica 1 — Quotation Addition (+41%)

A maior alavanca isolada testada no paper. Trazer 1-2 citações diretas (entre aspas) com fonte autoritativa no corpo do texto.

Antes (claim direto, sem fonte):

Schema markup ajuda LLMs a citarem seu conteúdo.

Depois (com Quotation Addition):

"Schema is a type of code that helps search engines and AI systems understand your content," diz a Semrush em fev/2026 — confirmando o que o estudo da Reddit r/DigitalMarketing mediu: páginas com schema foram citadas por IA 3,2× mais frequentemente que páginas sem.

A diferença é fonte autoritativa explícita + texto literal. LLM extrai o chunk e a citação inteira costuma ir junto — a fonte vai como Source na resposta gerada.

Onde aplicar: sob o H2 mais importante da página, logo após a explicação do conceito. Não inventar — citar de paper, .gov, fonte oficial, dado de imprensa.

Erro comum: parafrasear sem aspas. Vira opinião sua, não citação. Aspas + link = sinal claro de citação direta.

Técnica 2 — Statistics Addition (+32%)

Segunda maior alavanca. Usar números reais com qualificação ("medido em 80 contas em 2026"), não claims vagos ("muitas empresas").

Antes:

Automação de marketing reduz CAC.

Depois (com Statistics Addition):

Em 80+ implementações Huios entre 2022 e 2026, automação de marketing reduziu CAC em mediana 15-30% após 6 meses. Empresas que pulam a fase de discovery (definição de ICP + jornada) ficaram fora dessa faixa em ~40% dos casos.

Diferença: número específico, intervalo, condicional. LLM extrai o chunk inteiro porque é factualmente útil — adjetivos vagos não são extraíveis.

Regra prática: se você não consegue qualificar o número (período, amostra, fonte), não use. Inventar dado é pior que não ter dado nenhum — quando LLM cita, sua marca fica atrelada à mentira.

Onde aplicar: abertura do post + cada H2 técnico + FAQ. Em cada lugar onde tem claim quantitativo.

Técnica 3 — Cite Sources (+30%)

Terceira alavanca. Linkar fonte oficial com link clicável quando você fizer um claim factual.

Antes:

O Google libera AI Overviews em ~30% das queries informacionais.

Depois (com Cite Sources):

O Pew Research Center mediu queda mediana de CTR em torno de 8% nas SERPs com AI Overview ativo nos EUA em 2024-2025.

Diferença: link clicável pra fonte oficial. LLM segue o link no treino e durante o search — link clicável é um endorsement implícito. Mencionar "segundo o Google" sem link não conta como Cite Sources no paper Aggarwal.

Regra: todo claim factual numérico precisa de link pra fonte. Anedota Huios não precisa (é fonte primária — você é a fonte). Mas qualquer dado externo, link.

Técnica 4 — Fluency Optimization

Quarta alavanca. Menor que as 3 anteriores isoladamente, mas cumulativa em texto inteiro.

O que é: parágrafos curtos (3-5 frases), frases ativas (sujeito + verbo + objeto), sem subordinadas longas.

Antes:

A automação de marketing, quando implementada de maneira estruturada e com base em uma estratégia previamente definida pelo time de marketing em conjunto com o time comercial, considerando também as particularidades do ICP e da jornada do cliente, tende a apresentar resultados positivos no médio prazo.

Depois (com Fluency):

Automação de marketing dá ROI quando time de marketing e comercial alinharam ICP antes de configurar a ferramenta. Sem isso, o fluxo só replica o erro em escala.

Diferença: 1 frase de 51 palavras vs 2 frases de 14 e 12. Mesmo conteúdo, fluência muito maior. LLMs extraem mais facilmente texto bem-escrito — porque foram treinados em texto bem-escrito.

Regra de bolso: se você precisar reler a frase pra entender, ela é longa demais. Quebra em 2.

Técnica 5 — Estrutura de chunk (50-150 palavras)

Não é uma das 4 do Aggarwal, mas é onde as outras 4 são extraídas. LLMs não citam página inteira — citam chunks. Cada chunk precisa ser auto-contido.

O chunk típico que LLM extrai:

- Tem 50-150 palavras

- Tem H2 ou H3 que ecoa a query do usuário

- Tem resposta direta logo após o heading

- Tem 1-2 das técnicas (estatística + fonte, ou citação + link)

Schema FAQPage com chunks é o caso mais limpo: cada pergunta + resposta vira chunk natural extraível. Por isso esse post (e quase todos do blog Huios) tem seção FAQ no final.

Erro comum: post com 3.000 palavras sem H2 que ecoe pergunta do usuário. LLM olha, não acha chunk extraível, cita outro site. Tamanho de post não importa — estrutura sim.

Técnica 6 — Autoridade tópica (não autoridade de domínio)

LLMs reconhecem padrões de cluster. Domínio jovem com 30 posts focados em 1 tópico ganha de Forbes generalista nesse tópico.

Por quê: durante treino, o modelo associa entidades (Huios, GEO, automação de marketing) baseado em co-ocorrência repetida. Site com hub + 8 spokes sobre "automação de marketing" fica colado à entidade. Site que tem 1 post sobre o tema e 200 sobre outras coisas, não.

Como construir:

- Escolher 1 tópico-âncora (ex: GEO, automação de marketing, landing page)

- Publicar hub + 6-10 spokes em 30-90 dias

- Linkar spokes entre si com primeira âncora contextual sempre pro hub

- Manter

dateModifiedatualizado

Em 2026, isso é a alavanca de longo prazo mais cara mas mais defensável. Backlink você compra; cluster você constrói.

Caso real Huios: o post citado 2× pelo AI Overview

Em 30 de abril de 2026, publicamos Modo IA do Google sumiu: causas e como recuperar. Em maio, durante leitura de SERP da query "modo ia do google sumiu" no Google em pt-BR, o post apareceu 2 vezes como Source no AI Overview gerado.

Métricas (Google Search Console, 28 dias):

- 7 cliques · 259 impressões · posição média 5.9 · CTR 2.7%

- Tempo entre publicação e primeira citação no AIO: ~2 dias

Técnicas aplicadas no post:

- ✅ Quotation Addition: citação direta de Pew Research

- ✅ Statistics Addition: dados próprios ("12+ contas Huios monitoradas em 2026")

- ✅ Cite Sources: links pra Google Search Status Dashboard, Reddit, Anthropic docs, DMA UE

- ✅ Fluency: parágrafos de 3-5 frases

- ✅ Chunks: 7 FAQs com pergunta + resposta auto-contida

- ✅ Autoridade tópica: cluster com 3 posts sobre Modo IA linkados entre si

O que pesou na verdade? Provavelmente a combinação. SERP era frágil naquela query (rollback regional + cache + A/B test), o AIO precisou de fontes e o post tinha estrutura extraível. Não é replicável em qualquer query — funcionou porque a janela estava aberta.

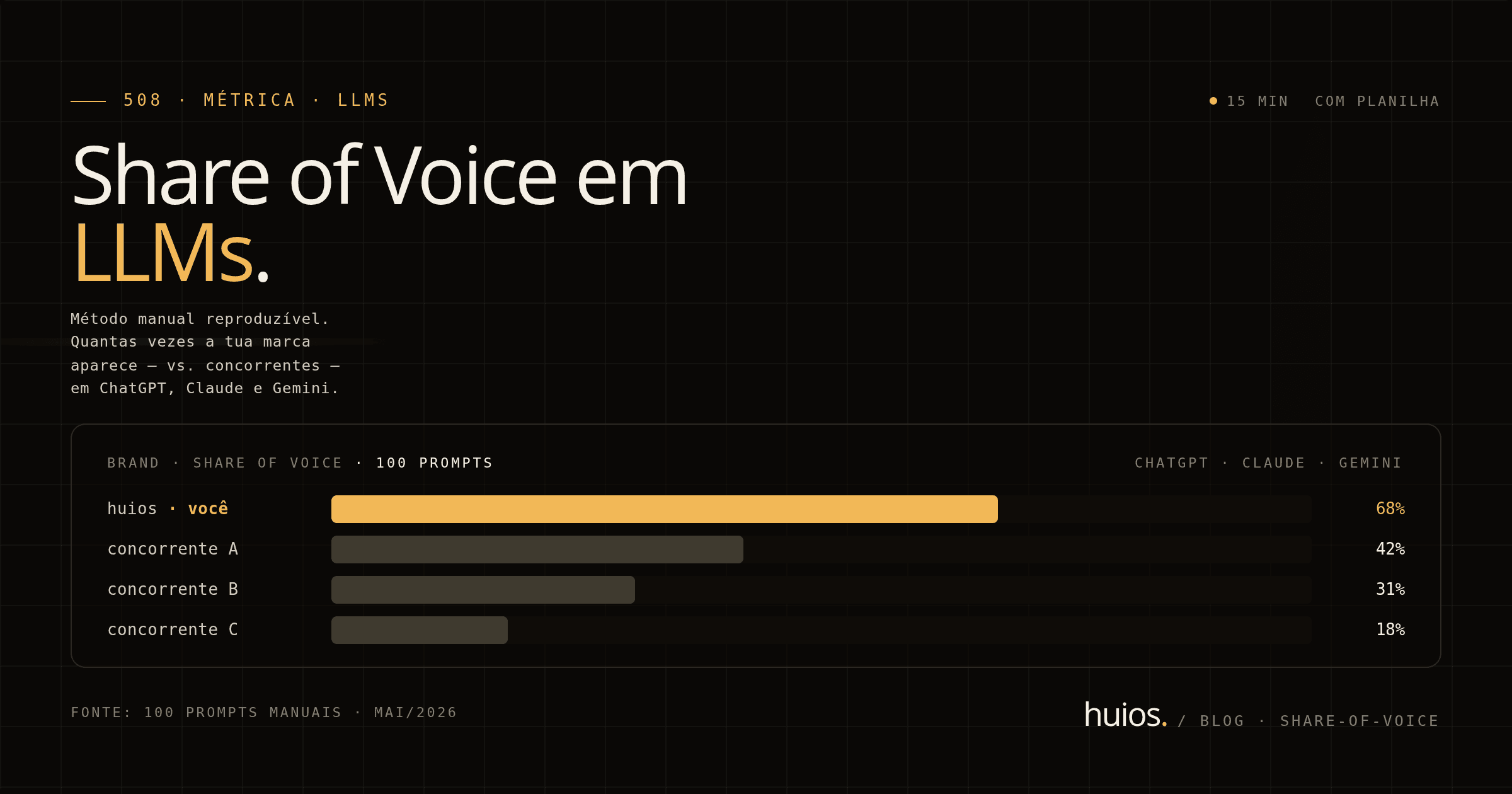

Como verificar se o ChatGPT te citou (manual)

Pra rastrear suas próprias citações sem ferramenta paga:

- Liste 10 queries-alvo (suas KW principais + variantes long-tail).

- Logout do ChatGPT ou janela anônima (resposta personalizada vira ruído).

- Cole cada query no ChatGPT com search ativado.

- Anote nas Sources: sua marca aparece? Em qual posição? Qual URL exata?

- Repita mensalmente mantendo as mesmas queries.

Tendência > snapshot. Uma medição não significa nada; 3 medições mensais começam a contar.

A Huios disponibiliza um template gratuito de tracker SOV em CSV pré-populado com queries-alvo reais e baseline maio/2026. Funciona em ChatGPT, Claude, Gemini, Perplexity e AI Overviews — 5 engines em uma planilha.

Pra automação completa (queries em escala), Profound e Otterly cobram US$ 99-250+/mês. Pra começar, manual resolve.

Perguntas frequentes

Quanto tempo até o ChatGPT começar a me citar?

Em SERP frágil ou KW emergente, 2-12 semanas é o que vejo na prática. Em SERP madura com competidores fortes, 6+ meses. Acelera quando seu cluster fica denso (mais de 5 posts no mesmo tópico) e quando o conteúdo aplica as técnicas Aggarwal de forma natural.

Preciso pagar pra aparecer em respostas do ChatGPT?

Não em 2026. ChatGPT Search é gratuito e cita fontes baseado em relevância + autoridade tópica. OpenAI tem um formulário pra cadastrar empresas em alguns produtos (ChatGPT Business), mas isso não afeta citação em respostas de search. Pagar Plus/Pro do ChatGPT também não dá vantagem.

ChatGPT cita sites pequenos sem autoridade?

Sim, em queries com SERP frágil ou nichos onde competidores são fracos. Nosso domínio (huiosweb.com.br) tem ~5 meses de existência em maio/2026 e foi citado pelo AI Overview do Google. Pesou autoridade tópica do cluster, não autoridade de domínio absoluta.

Schema markup é obrigatório pra ser citado?

Não obrigatório, mas ajuda significativamente. O estudo do Reddit r/DigitalMarketing (1 semana atrás em maio/2026) mediu páginas com schema sendo citadas por IA 3,2× mais frequentemente. Schema FAQPage e Article são os tipos com maior retorno. Detalhe em schema markup para IA (em produção).

ChatGPT cita conteúdo em português?

Sim — e em 2026 cada vez mais. ChatGPT-5 tem cobertura forte de pt-BR e cita fontes brasileiras quando elas estão indexadas no Bing. Conteúdo em pt-BR de qualidade tem menos competição que em inglês — janela aberta pra agência ou criador BR.

Posso forçar citação enviando meu site pra OpenAI?

Não há canal oficial pra "submeter pra citação". O que dá pra fazer: garantir indexação no Bing Webmaster Tools, liberar OAI-SearchBot e GPTBot no robots.txt, e aplicar as 6 técnicas deste post. ChatGPT descobre o resto via crawl e treino.

Bloquear GPTBot afeta citação no ChatGPT Search?

Bloquear GPTBot afeta o treino do modelo (sua marca não vira menção implícita). Pra ChatGPT Search (citação com link em tempo real), o crawler é OAI-SearchBot — bloquear esse específico tira você do search. A maioria dos sites quer manter ambos liberados em 2026; só faz sentido bloquear se você tem produto pago e não quer competir com versão gratuita gerada por IA.

Próximos passos

Pra implementar as 6 técnicas no seu próprio site, GEO checklist 2026: 30 ações pra ranquear em LLMs (em produção) traz a lista priorizada por fase.

Pra entender a diferença entre GEO e SEO clássico (e por que SEO técnico virou pré-requisito), leia GEO vs SEO em 2026.

Pra o caso real do post que foi citado, Modo IA do Google sumiu: causas e como recuperar é o post que serviu de cobaia.

Atualizado em maio de 2026. Próxima revisão prevista: agosto de 2026 ou quando OpenAI mudar política de citação no ChatGPT Search.

Publicado em 08 de maio de 2026 · Por Equipe Huios